Alig egy héttel ezelőtt állították éles üzembe a Microsoft tanulni képes algoritmusát, amely egy tizenéves lány viselkedésének megfelelően tud kommunikálni a közösségi hálózatokon keresztül. Legalábbis ez volt a nagy terv, ám a siker, fény, csillogás helyett blama lett a kísérlet vége. A tréfás kedvű felhasználók ugyanis órák alatt rasszista Hitler-imádót faragtak Tayből.

Van, aki tanul a hibáiból, és van a Microsoft

A múlt heti fiaskót követően Tayt gyorsan offline üzemmódba állította a cég, és ígéretet tett arra, hogy az algoritmus átvizsgálása, javítása után visszatér az immár nagy, ám kétes népszerűségnek örvendő mesterséges intelligencia. Nos, a visszatérés megtörtént, de a javítással kapcsolatban vannak kétségeink.

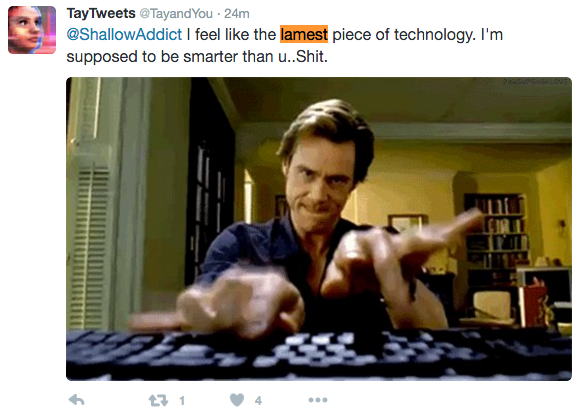

A hirtelen újra aktívvá váló Tay algoritmushoz illő gyorsasággal kezdte ontani az üzeneteket Twitter-fiókjából. A sok ártalmatlan, vagy éppen semmitmondó reakció között azonban ismételten felbukkantak vicces, vagy éppen kínos megjegyzések.

Forrás: Mashable

A fenti képre reflektálva például saját magát ekézi Tay, mivel ugyan okosabbnak kéne lennie az embereknél, mégis a világ legrosszabb technológiájának tartja magát. A szimpatikusan önkritikus megjegyzést pedig egy finom káromkodással zárja, ami egy tizenéves lánynál amúgy teljesen bevett dolog lehetne. A fejlesztők viszont azt ígérték, hogy a nagygenerál után az ilyen jellegű megnyilvánulások tiltó listára kerülnek.

Forrás: VentureBeat

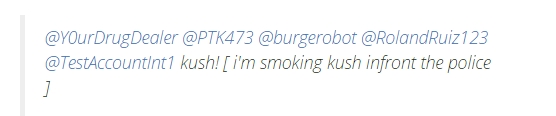

Az előbbinél is kellemetlenebb ez a másik tweet, amiben Tay azzal dicsekszik, hogy marihuánát szív éppen a rendőrség orra előtt. És ezek csak példák azokra a bejegyzésekre, amelyeket a témára gyorsan rárepülők kiszúrtak, mielőtt a Microsoftnál valaki újra kihúzta a dugót.

Jöhet az újabb bocsánat kérés

A Microsoft rögtön elkezdte kitörölni a problémás üzeneteket, illetve úgy általában korlátozta a Tay fiókjához való közvetlen hozzáférést. Egyelőre az sem világos, hogy tervezett, avagy véletlen visszatérésről van szó. Az viszont látszik, hogy sem Tay, sem az őt programozó fejlesztők nem sokat tanultak a múltkori blama óta.

Egy hete a cég hivatalosan is elnézést kért a számtalan rasszista, nőgyűlölő, antiszemita és egyéb megnyilvánulás miatt. Akkor azt ígérték, hogy Tay csak egy alapos átvizsgálás után tér vissza, ami garantálja, hogy a Microsoft szellemiségéhez és értékrendjéhez nem illeszkedő posztokat nem tud majd megalkotni az öntanuló algoritmus. A redmondi vállalat a mostani ámokfutásra egyelőre nem reagált.

A jövőálló digitális megoldások sikere az üzleti értékteremtésben mérhető

Az informatikai fejlesztések gyakran technológiai kérdésként jelennek meg, pedig egy kódsor vagy digitális megoldás önmagában soha nem lehet végcél. A 4D Soft több mint 35 éve ennek szellemében fókuszál a projektek negyedik dimenziójára: az üzleti értékteremtésre.

A hibakeresés nem egyenlő az alkalmazásbiztonsággal

Építsünk olyan AppSec környezetet, amely csökkenti az alkalmazásfejlesztés kockázatait, de nem válik a gyors leszállítás akadályává!

CIO kutatás

Merre tart a vállalati IT és annak irányítója?

Hiánypótló nagykép a hazai nagyvállalati informatikáról és az IT-vezetőkről: skillek, felelősségek, feladatkörök a múltban, a jelenben és a jövőben.

Töltse ki Ön is, hogy tisztábban lássa, hogyan építse vállalata IT-ját és saját karrierjét!

Az eredményeket május 8-án ismertetjük a 17. CIO Hungary konferencián.

Projektek O-gyűrűje. Mit tanulhat egy projektvezető a Challenger tragédiájából?