Nyilvánosságra hozták azt a 11 pontos kódexet, amely alapján a világ legfejlettebb országai a mesterségesintelligencia-fejlesztéseiket szabályozni kívánják. Az alapelvek már ismertek voltak, miután a tervezet néhány részlete kiszivárgott.

A tizenegy pontban nagy meglepetések nincsenek. Ahogy azt várni lehetett, alapvetően a kockázatalapú megközelítés érvényesül. A dokumentum első pontja ki is mondja: a fejlesztőknek az MI teljes életciklusát végig kell kísérniük a kockázatok azonosítása, értékelése és csökkentése érdekében. Ebbe be kell vonniuk többek között független külső tesztelőket. Ugyanezen elvet kell érvényesíteniük az MI-t használó szervezeteknek: amellett, hogy az MI-t rendeltetésszerűen kell használniuk, folyamatosan nyomon kell követniük a kockázatait, beleértve a biztonsági sebezhetőségeket.

Ezeknek a szabályoknak a betartásához ki kell alakítani olyan felületeket, melyek biztosítják az MI-rendszerek átláthatóságát például azáltal, hogy nyilvánossá teszik a modellek használhatóságának a korlátait, a visszaéléseket és így tovább. Szintén kellenek hatékony kommunikációs csatornák a fejlesztők egymás közötti, valamint az állami, civil és tudományos szervezetekkel történő felelősségteljes információmegosztására.

Mivel a szabályozás megközelítése kockázatalapú, a szervezeteknek ki kell dolgozniuk egy MI-re vonatkozó szabályzatot (governance, kockázatkezelés, adatvédelem, kockázatcsökkentő intézkedések), amihez megfelelő biztonsági ellenőrzésre van szükség (fizikai biztonság, kiberbiztonság, belső fenyegetések elleni védelem).

A szöveg már tükrözi az elmúlt időszak MI-vel kacsolatos tapasztalatait. Kitér például a tartalomhitelesítés fontosságára: egyértelműen azonosíthatóvá kell tenni az MI-vel készült tartalmakat. Valamint célzottan kell kutatni a mesterséges intelligencia társadalmi, biztonsági és védelmi kockázatait.

A G7-ek fontosnak tartották kiemelni: az MI kiemelt szerepet tölthet be a világ legnagyobb kihívásainak (pl. éghajlat, egészségügy, oktatás) kezelésében. Emiatt is fontos, hogy mielőbb szülessenek nemzetközi technikai szabványok, melyeket az országok széles köre elfogad, és amelyek a személyes adatok és a szellemi tulajdon védelmét is garantáló adatbeviteli módszereket biztosítanak.

Mindenki elismeri: szükség lesz a nemzetközi összefogásra

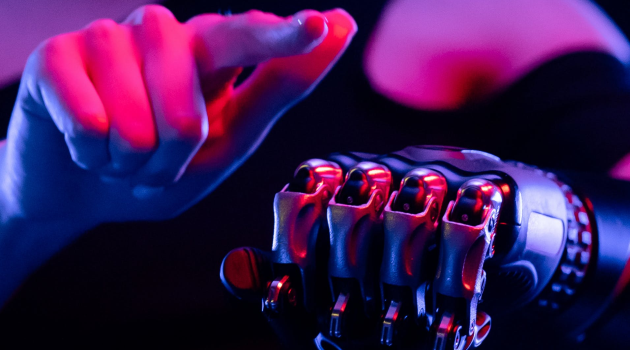

A ChatGPT robbanásszerű sikere tette teljesen világossá, hogy a fejlett mesterséges intelligenciák fejlesztését nem lehet nemzeti keretek között szabályozni. A "hogyanról" azonban a fejlesztésben élen járó országok álláspontja lassan közeledik egymáshoz: az EU elsősorban az adatvédelem felől közelít a problémához, az USA egyelőre az "ami nem tilos, azt szabad" álláspontot képviseli, és óvatosan kezeli a témát, Kína pedig a szigorú és szoros állami felügyeletben bízik. Ezeknek az álláspontoknak a közelítésére tett kísérletet a G7-nyilatkozattal párhuzamosan – de attól nem függetlenül – a brit miniszterelnök, Rishi Sunak. Összehozott egy nemzetközi konferenciát (AI Safety Summit), amelyen az MI-ipar érintettjei (pl. Elon Musk vagy Sam Altman) mellett 25 állam, köztük az Európai Unió, Kína és az USA képviseltette magát.

A megbeszélésen elfogadott dokumentum, az ún. Bletchley-nyilatkozat három fontos megállapítást tesz. Az MI óriási lehetőség az emberiség számára; ennek megfelelően a kockázatai is óriásiak; a kockázatokat csak globális összefogással lehet kezelni. (A dokumentum neve a konferencia helyszínére, a Bletchley Parkra utal. A helyszín amúgy szimbolikus: az épületében dolgoztak a 2. világháború alatt a brit kódtörők, köztük Alan Turing matematikus.)

A megbeszélésnek azonban az általánosságokat megfogalmazó nyilatkozaton túl van egy valóban fontos eredménye: Kína és az USA egyaránt hajlandóságot mutatott arra, hogy egymással is együttműködjenek az MI nemzetközi szabályozásában.

2026-ban a vállalkozások minden eddiginél több adatot generálnak és használnak. Az előrelátó vállalatok ezért újraértékelik a megközelítésüket: mi lenne, ha a tárolás, a biztonsági mentés és az együttműködés egyetlen rendszerben kezelhető lenne?

Projektek O-gyűrűje. Mit tanulhat egy projektvezető a Challenger tragédiájából?